全范围内稳健的部分对部分点云注册

由于稀疏和嘈杂的测量、不完整的观测和巨大的变换,三维物体的点云注册是非常具有挑战性的。在这项工作中,我们提出了图谱匹配共识网络(GMCNet),它为全范围1部分到部分的点云注册(PPR)估计对等的对应关系。为了编码稳健的点描述符,1)我们首先全面研究了各种几何特征的变换稳健性和噪声弹性。2)然后,我们采用了一个新的变换稳健点变换器(TPT)模块,以适应性地聚合考虑结构关系的局部特征,该模块利用了手工制作的旋转不变量($RI$)特征和抗噪空间坐标的优势。3)基于层次图网络和图形建模的协同作用,我们提出了层次图建模(HGM)架构来编码稳健的描述符,其中包括:i)从$RI$特征中学习的单项术语;ii)通过TPT模块从不同尺度的相邻点关系中编码的多个平滑度术语。此外,我们用虚拟扫描构建了一个具有挑战性的PPR数据集(MVP-RG)。广泛的实验表明,GMCNet的性能优于以前最先进的PPR方法。值得注意的是,GMCNet为每个点云单独编码点描述符,而不使用跨环境信息,也不使用训练用的地面真相对应。我们的代码和数据集将在网页链接。

《Robust Partial-to-Partial Point Cloud Registration in a Full Range》

论文地址:网页链接

对语音识别系统的对抗性攻击中的语言依赖性

自动语音识别(ASR)系统无处不在地存在于我们的日常设备中。它们很容易受到对抗性攻击,即被操纵的输入样本欺骗了ASR系统的识别。虽然已经分析了各种英语ASR系统的对抗性例子,但还没有跨语言的脆弱性比较分析。 我们以Deepspeech为例,比较德语和英语ASR系统的可攻击性。我们研究了其中一个语言模型是否比另一个更容易被操纵。我们的实验结果表明,英语和德语在成功生成对抗性例子所需的计算努力方面存在着统计上的显著差异。这一结果鼓励我们进一步研究ASR的鲁棒性分析中与语言相关的特征。

《Language Dependencies in Adversarial Attacks>

在语言模型的联合学习中恢复私人文本

联邦学习允许分布式用户协作训练模型,同时保持每个用户的数据私密。最近,越来越多的工作表明窃听攻击者可以有效地从联邦学习期间传输的梯度中恢复图像数据。然而,在恢复文本数据方面进展甚微。在本文中,我们提出了一种新颖的攻击方法 FILM,用于语言模型的联合学习——我们首次展示了从多达 128 个句子的大批量中恢复文本的可行性。与针对匹配梯度优化的图像恢复方法不同,我们采用了一种独特的方法,首先从梯度中识别一组单词,然后基于波束搜索和基于先验的重新排序策略直接重建句子。我们攻击的关键见解是利用预先训练的语言模型中的先验知识或训练期间的记忆。尽管它很简单,但我们证明 FILM 可以很好地处理多个大规模数据集——即使对于大批量大小,它也可以高保真地提取单个句子,并且如果迭代应用攻击,它可以成功地从批量中恢复多个句子。我们希望我们的结果能够激发未来的工作,以开发更强的攻击以及在联邦学习中训练语言模型的新防御方法。我们的代码在 GitHub - Princeton-SysML/FILM: Official repo for the paper: ... 上公开可用。

《Recovering Private Text in Federated Learning of Language Models》

论文地址:网页链接

论深层神经网络中对抗性稳健性与决策区域的关系

一般来说,深层神经网络(DNNs)是通过在训练阶段排除的未见过的数据上测量的泛化性能来评估的。.随着DNN的发展,泛化性能趋向于最先进的水平,仅仅根据这一指标来评估DNN变得很困难。.对抗对抗性攻击的鲁棒性已被用作评估DNN的一个额外指标,即衡量其脆弱性。.然而,很少有研究从DNN的几何学角度来分析对抗性稳健性。.在这项工作中,我们进行了一项实证研究,以分析在对抗性攻击下影响模型稳健性的DNN的内部属性。.特别是,我们提出了 "填充区域集"(PRS)的新概念,其中训练样本被更频繁地填充,以代表实际环境中DNN的内部属性。.通过对所提概念的系统实验,我们提供了经验性的证据,证明低PRS比率与DNN的对抗性稳健性有很大关系.我们还设计了PRS正则器,利用PRS的特点来提高对抗性稳健性,而不需要进行对抗性训练。.

《On the Relationship Between Adversarial Robustness and Decision Region in Deep Neural Network》

论文地址:网页链接

在变异量子机器学习中利用对称性

变分量子机器学习是近期量子计算机的广泛研究应用。变分量子学习模型的成功在很大程度上取决于找到合适的模型参数化,该参数化编码与学习任务相关的归纳偏差。然而,对于构建合适参数化的指导原则知之甚少。在这项工作中,我们全面探讨了何时以及如何利用学习问题的对称性来构建在学习任务的对称性下结果不变的量子学习模型。基于表示理论的工具,我们展示了如何通过门对称化过程将标准门集转换为尊重手头问题对称性的等变门集。我们在两个具有非平凡对称性的玩具问题上对所提出的方法进行了基准测试,并观察到泛化性能的显着提高。由于我们的工具也可以直接应用于其他具有对称结构的变分问题,因此我们展示了如何使用等变门集来解决变分量子特征求解器。

《Exploiting symmetry in variational quantum machine learning》

论文地址:网页链接

BEVerse: 以视觉为中心的自动驾驶的鸟瞰式统一感知和预测

在本文中,我们提出了 BEVerse,这是一个基于多摄像头系统的 3D 感知和预测统一框架。与现有的专注于改进单任务方法的研究不同,BEVerse 的特点是从多摄像头视频中生成时空鸟瞰图 (BEV) 表示,并联合推理以视觉为中心的自动驾驶的多个任务。具体来说,BEVerse 首先执行共享特征提取和提升,以从多时间戳和多视图图像生成 4D BEV 表示。在自我运动对齐之后,时空编码器用于在 BEV 中进行进一步的特征提取。最后,连接多个任务解码器用于联合推理和预测。在解码器中,我们提出了网格采样器来为不同的任务生成具有不同范围和粒度的 BEV 特征。此外,我们设计了迭代流的方法,用于内存有效的未来预测。我们表明,时间信息改进了 3D 对象检测和语义图构建,而多任务学习可以隐含地有利于运动预测。通过对 nuScenes 数据集的大量实验,我们表明多任务 BEVerse 在 3D 对象检测、语义地图构建和运动预测方面优于现有的单任务方法。与顺序范式相比,BEVerse 也有利于显着提高效率。代码和训练模型将在 网页链接 发布。

《BEVerse: Unified Perception and Prediction in Birds-Eye-View for Vision-Centric Autonomous Driving》

论文地址:网页链接

UncertaINR:用于计算机断层扫描的端到端隐式神经表征的不确定性量化

隐性神经表征(INRs)在场景重建和计算机图形方面取得了令人印象深刻的成果,其性能主要是根据重建精度进行评估。然而,在医学影像学中,重建问题是不确定的,模型预测为高风险的诊断提供信息,INR推断的不确定性量化是关键。为此,我们研究了UncertaINR:基于INR的图像重建的贝叶斯模型,用于计算机断层扫描(CT)。我们测试了UncertaINR的几个贝叶斯深度学习实现,发现它们实现了良好的不确定性校准,同时保持了与其他经典、基于INR和基于CNN的重建技术相竞争的准确性。与之前表现最好的方法相比,UncertaINR不需要大量的训练数据集,而只需要少量的验证图像。

《UncertaINR: Uncertainty Quantification of End-to-End Implicit Neural Representations for Computed Tomography》

论文地址:网页链接

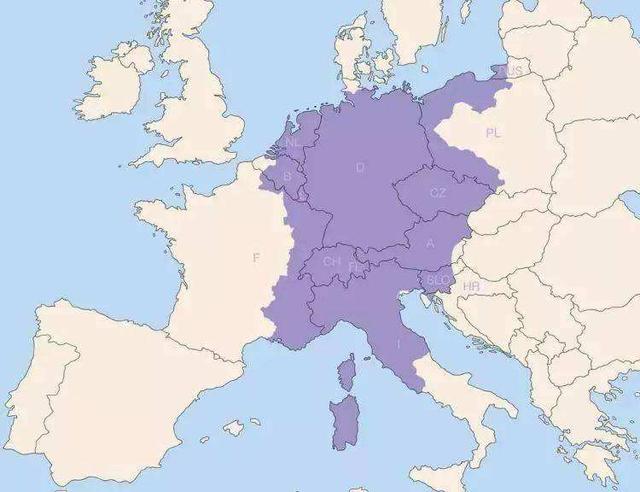

FairLex: 评估法律文本处理公平性的多语言基准

我们提出了一个由四个数据集组成的基准套件,用于评估预先训练的语言模型的公平性,以及用于为下游任务微调它们的技术。我们的基准涵盖了四个司法管辖区(欧洲委员会、美国、瑞士和中国),五种语言(英语、德语、法语、意大利语和汉语)和五个属性(性别、年龄、地区、语言和法律领域)的公平性。在我们的实验中,我们使用几种群体稳健性的微调技术对预训练的语言模型进行了评估,结果表明,在许多情况下,表现出的群体差异是充满活力的,而没有一种技术能够保证公平性,也没有持续地缓解群体差异。此外,我们对我们的结果进行了定量和定性的分析,强调了在法律NLP中发展稳健性方法的公开挑战。

《FairLex: A Multilingual Benchmark for Evaluating Fairness in Legal Text Processing》

论文地址:网页链接

理解视觉变压器的稳健性

最近的研究表明,视觉变换器(ViTs)表现出强大的鲁棒性,可以抵御各种破坏。尽管这一特性部分归因于自我注意机制,但仍然缺乏系统的理解。在本文中,我们研究了自我注意在学习稳健表征中的作用。我们的研究是由《视觉变形》中出现的视觉分组的耐人寻味的特性所激发的,这表明自我注意可能通过改善中层表征来促进稳健性。我们进一步提出了一个完全注意力网络(FANs)系列,通过纳入注意力通道处理设计来加强这种能力。我们在各种层次的主干上全面地验证了这种设计。我们的模型在ImageNet-1k和ImageNet-C上达到了87.1%的准确率和35.8%的mCE,参数为7680万。我们还在两个下游任务中展示了最先进的准确性和稳健性:语义分割和物体检测。代码将在网页链接。

《Understanding The Robustness in Vision Transformers》

论文地址:网页链接

非凸和非光滑优化中的参数和收敛稳定性表征: 一种几何方法

我们考虑在最小化一个连续(可能是参数化的、非凸的和非光滑的)实值函数$f$时的稳定性问题。如果一个点的所有可能的方向导数都是非负的,我们称之为静止点。在这项工作中,我们着重于$f$静止点的两个稳定性概念:参数稳定性和收敛稳定性。参数化的考虑在各个领域都有广泛的研究,包括平滑分析、数值稳定性、条件数和线性编程的敏感性分析。参数化的稳定性问的是参数上的微小扰动是否会导致静止点的位置和$f$值发生巨大的变化。任何由优化算法迭代产生的点序列都不能脱离静止点的邻域,但在这种静止点对精度参数和算法的数字误差是稳定的意义上,会接近它。事实证明,这些概念与几何理论有着深刻的联系。我们表明,参数稳定性与函数图的变形有关。另一方面,收敛稳定性涉及到函数域的共享分区。利用这些联系,我们为广泛的函数和优化算法证明了这两个稳定性概念的相当严格的条件,并有足够小的步长和精度参数。这些条件是微妙的,因为稍弱的函数要求会与原始的直觉相反,导致错误的结论。我们提出了这个理论的三个应用。这些应用揭示了对纳什均衡计算、非凸和非光滑优化以及深度神经网络的新优化方法学的一些理解。

《Characterizing Parametric and Convergence Stability in Nonconvex and Nonsmooth Optimizations: A Geometric Approach》

论文地址:网页链接